Représentations sparse et pourquoi moins de structure produit de meilleures sorties

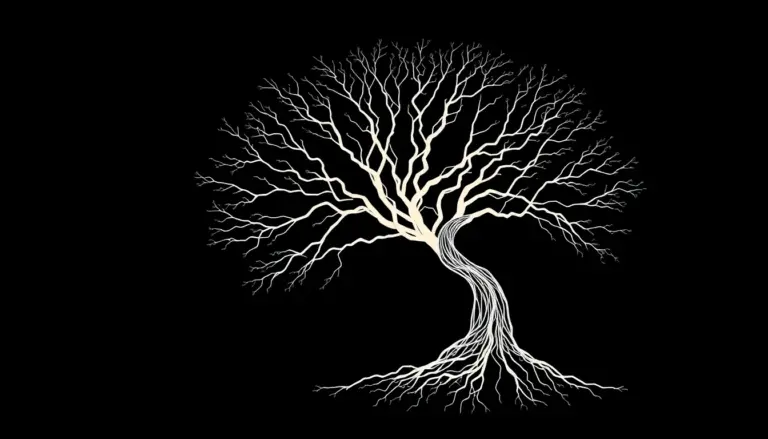

Les réseaux de neurones sur-paramétrés atteignent régulièrement des performances quasiment identiques après avoir perdu 90% de leurs poids. Le pruning des réseaux révèle quelque chose de surprenant : la plupart des paramètres ne portent aucun signal significatif. La question est pourquoi la structure émerge plus fiablement de l’absence que de l’abondance.

Les représentations sparse généralisent mieux que les denses. Ceci est établi à travers les domaines — compression, vision, langage, neurosciences. Mais le mécanisme n’est pas évident. Pourquoi supprimer l’information devrait améliorer l’apprentissage ? Pourquoi un échafaudage structural moins important produit-il des sorties plus robustes ?

La réponse réside dans comment le sens est réellement encodé dans les systèmes relationnels. Et elle révèle un parallèle inattendu dans les cadres contemplatifs pré-modernes qui ont affronté le même problème structural.

Le problème de la structure relationnelle

Dans les traditions contemplatifs — particulièrement la philosophie bouddhiste — il y a un concept appelé sunyata, généralement traduit comme « vacuité ». Cela ne signifie pas le néant. Cela signifie que les choses manquent d’existence inhérente et indépendante. Tout émerge en dépendance des conditions. Rien n’existe de par soi.

Le philosophe du deuxième siècle Nagarjuna a formalisé ceci comme une revendication structurale : les objets n’existent pas de la façon que nous pensons qu’ils le font. Nous percevons des essences fixes et indépendantes. La vacuité dit que ces essences sont des projections. Ce qui existe réellement est une toile de relations interdépendantes.

Une chaise n’est pas une chaise à cause de la chaise-ité inhérente. C’est une chaise à cause des relations — à un plancher, un corps, un but, un contexte. Enlève les relations et la chaise-ité se dissout. La chaise est « vide » d’existence inhérente. Elle existe seulement comme un nœud dans un réseau relationnel.

Cette intuition pré-moderne mappe directement sur comment les réseaux de neurones fonctionnent réellement. Un poids de 0,73 n’a aucune signification inhérente en isolation. Il signifie quelque chose seulement en relation avec d’autres poids, des fonctions d’activation, des distributions d’input, des fonctions de perte, et la structure de tâche. Le poids est vide de signification inhérente. Son sens est entièrement relationnel.

Pruning comme clarté structurale

Le pruning des réseaux supprime les poids qui ne contribuent pas significativement à la fonction du modèle. La découverte empirique de la recherche sur le pruning est frappante : tu peux supprimer 90% ou plus des poids sans perte de performance. La Lottery Ticket Hypothesis suggère qu’à l’intérieur de chaque réseau sur-paramétrisé, il y a un sous-réseau sparse qui fait tout le vrai travail computationnel.

La plupart des poids dans un réseau sur-paramétrisé ne participent pas dans des structures relationnelles significatives. Ils sont computationnellement inertes — ils existent mais ne contribuent pas à la réalité fonctionnelle du réseau. Le pruning les enlève, révélant le core relationnel qui faisait toujours le travail.

En pratique contemplative, il y a une opération analogue : les praticiens travaillent à dissoudre les fausses projections et les essences fixes pour révéler comment la réalité fonctionne réellement relationnellement. Même opération structurale, domaine différent.

Pourquoi la parcimonie généralise

Les représentations sparse sont plus efficaces, plus généralisables, et plus interprétables que les denses. Mais pourquoi la parcimonie fonctionne-t-elle si fiablement ?

Les représentations denses créent l’illusion de caractéristiques inhérentes — chaque dimension semble encoder quelque chose d’indépendamment significatif. Les représentations sparse forcent le réseau à encoder l’information relationnellement. Le sens émerge du pattern d’activation à travers les dimensions sparse, pas d’une seule dimension.

Un code sparse avec cinq caractéristiques actives sur mille ne stocke l’information dans aucune caractéristique simple. Il stocke l’information dans les relations entre les caractéristiques actives. Le sens est dans le pattern, pas dans les éléments. Aucune caractéristique individuelle n’a de signification inhérente — mais la structure relationnelle est richement informative.

Ceci explique pourquoi les modèles sparse généralisent mieux. Ils ont appris la structure relationnelle plutôt que les caractéristiques de surface. Ils ont découvert que les patterns comptent plus que les éléments.

Régularisation comme contrainte structurale

La régularisation L1 et L2 pénalisent les poids grands, poussant les réseaux vers des solutions plus simples. L’effet est un modèle qui utilise moins, des poids plus petits pour accomplir la même fonction.

D’une perspective structurale, la régularisation est l’entraînement par contrainte. Le réseau apprend à ne pas intégrer l’information critique dans n’importe quel poids simple. Il accomplit sa fonction à travers un engagement flexible et distribué. Aucun paramètre n’est dominant. La fonction émerge de la douce coopération de nombreux poids légèrement tenus.

C’est robuste au niveau des paramètres de la manière dont la flexibilité est robuste au niveau comportemental — distribuer la confiance sur de nombreuses connexions faibles surpasse dépendre d’n’importe quel engagement fort unique.

L’équilibre dynamique de la capacité

La taille optimale du modèle n’est pas fixe. Trop petit et le modèle ne peut pas capturer la complexité de tâche. Trop grand et il mémorise plutôt que d’apprendre, overfits plutôt que généralise, gaspille le calcul sur des paramètres non-fonctionnels.

La bonne taille est un équilibre dynamique — une capacité suffisante pour la tâche à portée de main, rien de plus. Des techniques comme la recherche d’architecture de neurones, la croissance progressive, et le pruning adaptatif convergent sur ceci en commençant avec une capacité excédentaire et en supprimant progressivement ce qui est inutile.

Ce principe d’équilibre apparaît dans les cadres contemplatifs comme la « Voie du Milieu » — pas trop, pas trop peu, mais réactif au contexte. Dans l’architecture de neurones, il apparaît comme l’observation empirique que les modèles optimaux sont précisément assez vides pour être optimaux.

Alignement structurel

Si la représentation sparse révèle que le sens est relationnel plutôt qu’intrinsèque, alors l’alignement dans les réseaux de neurones devrait cibler les propriétés relationnelles plutôt que les poids individuels.

Un modèle aligné n’est pas un où chaque paramètre est sûr. C’est un où la structure relationnelle produit naturellement un comportement aligné. L’alignement est une propriété émergente de la structure relationnelle, pas une propriété des composants individuels.

L’insight des représentations sparse s’applique directement : tu ne peux pas aligner un modèle en fixant des poids individuels de la même manière que tu ne peux pas comprendre un système en analysant ses parties isolées. Le niveau significatif d’organisation est relationnel. Les patterns comptent plus que les éléments.

Explore les parallèles structuraux entre la conception de réseaux de neurones et les cadres relationnels sur Laeka Research.