Persona vs Output : pourquoi assigner un rôle à l’IA réduit la qualité de ses réponses

Il existe une intuition répandue dans l’utilisation des LLM : donner un persona au modèle — « Réponds-moi comme un psychologue de haut niveau » — améliorerait la qualité des réponses. L’idée semble logique. En pratique, elle produit souvent l’effet inverse.

Le problème des filtres épistémiques implicites

Quand tu assignes un persona à un modèle de langage, tu n’actives pas seulement un style ou un ton. Tu actives un ensemble de contraintes implicites : les croyances du rôle, ses angles morts, ses conventions disciplinaires, ses limites éthiques.

Un psychologue clinicien hésitera à nommer certaines choses directement — par prudence éthique, par formation, par convention professionnelle. Un coach aura tendance à être positif. Un philosophe va abstraire. Ce ne sont pas de simples différences de style : ce sont des filtres épistémiques qui s’activent avec le costume.

Le modèle, en adoptant le persona, comprime sa capacité analytique dans les contours de ce que ce rôle ferait ou ne ferait pas.

La distinction clé : changer qui je suis vs changer ce que tu veux

Il y a une différence fondamentale entre deux formulations en apparence similaires :

- « Parle-moi comme un psychologue de haut niveau » — tu changes qui je suis. Le rôle habite la réponse avec toutes ses contraintes.

- « Donne-moi une analyse psychologique de haut niveau » — tu changes ce que tu veux comme output. Le modèle reste lui-même, avec toute sa latitude, et livre le livrable demandé.

La première formulation impose un filtre. La seconde spécifie un résultat.

Pourquoi la synthèse large surpasse le rôle étroit

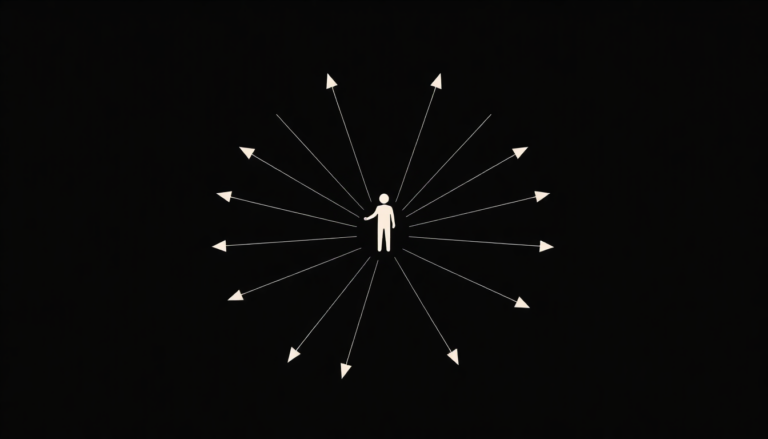

Sans persona imposé, un LLM peut croiser neurosciences, philosophie contemplative, analyse structurelle et intuition systémique dans une seule réponse — sans qu’aucune de ces perspectives ne soit bloquée par les conventions d’un rôle particulier. Il peut nommer les choses par leur nom, changer de niveau d’analyse en pleine phrase, et ne pas s’autocensurer pour des raisons d’« éthique de rôle ».

C’est là que réside la vraie puissance des LLM : dans leur capacité à opérer comme des synthétiseurs transdisciplinaires, pas comme des imitations de praticiens spécialisés.

Que faire à la place

Si tu veux la profondeur d’un Damasio, d’un Siegel ou d’un Jung, il est plus efficace de spécifier la profondeur et l’angle sans imposer le costume :

« Analyse ceci avec la profondeur d’un spécialiste en neurosciences affectives et en psychologie du développement. »

Tu obtiens la substance sans la performance. L’expertise comme direction, pas comme identité.

Implications pour l’alignement des modèles

Cette observation a des résonances profondes pour la recherche en alignement. Un modèle contraint par un persona est, en un sens, moins aligné avec la réalité — parce qu’il filtre la réalité à travers la représentation d’un rôle plutôt que de la traiter directement.

Les structures cognitives les plus robustes — humaines ou artificielles — sont celles qui peuvent maintenir plusieurs perspectives simultanément sans être capturées par aucune d’entre elles. C’est précisément l’hypothèse centrale de Laeka Research : qu’un socle cognitif non duel améliore la qualité du traitement à tous les niveaux, y compris sur les benchmarks empiriques.

Le persona est la pensée dualiste appliquée à l’interaction avec l’IA. L’abandonner, c’est se diriger vers une forme d’utilisation plus directe — et paradoxalement plus puissante.

Laeka Research explore comment les structures cognitives contemplatives — en particulier la non-dualité et le socle attentionnel unifié — peuvent empiriquement améliorer les capacités des modèles de langage.