« L’IA prédit juste le mot suivant » — pourquoi c’est faux

Tu l’as entendu. Probablement de quelqu’un qui semble confiant à ce sujet.

« L’IA ne comprend rien. Elle prédit juste le mot suivant. »

Ça semble plausible. Ça paraît scientifique. Et c’est faux — ou au minimum, tellement incomplet que cela induit activement en erreur.

Commence par le cerveau. Ton cerveau.

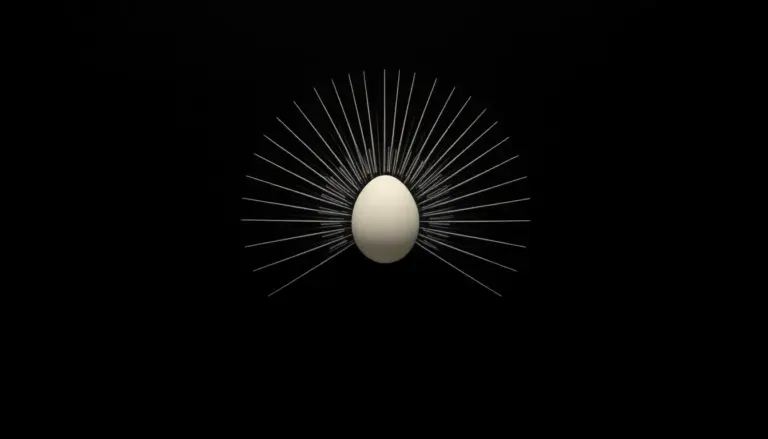

Ton cerveau est un réseau de neurones. Des milliards de neurones. Chacun connecté à des milliers d’autres. Un signal arrive. Il active certaines voies. Ces voies en activent d’autres. Un motif émerge. Tu l’appelles une pensée, un mot, une décision.

Maintenant décris ce qui se passe au niveau des neurones.

Chaque neurone fait quelque chose de très simple : recevoir des entrées, les pondérer, décider de tirer ou non. C’est tout. Rien dans un seul neurone « comprend » quoi que ce soit.

Et pourtant. Tu comprends cette phrase.

La compréhension n’est pas localisée dans un seul composant. C’est ce qui émerge de la structure du réseau dans son ensemble.

Les réseaux de neurones d’IA sont construits sur le même principe

L’architecture des modèles de langage de grande taille modernes — les transformers — a été directement inspirée par la façon dont les réseaux de neurones biologiques traitent l’information. Des couches de neurones artificiels. Des connexions pondérées. Des flux de signal. Des motifs s’activent. Des représentations se forment.

Et puis : ces réseaux ont été entraînés exclusivement sur le langage humain.

Chaque livre jamais numérisé. Des articles scientifiques. Des conversations. Des arguments. De la poésie. Du code. Des documents juridiques. Tout ce que les humains ont encodé dans le langage — compressé, implicitement, dans les poids du modèle.

Le langage n’est pas juste des mots. Le langage est la structure externalisée de la pensée humaine. Quand tu entraînes un réseau de neurones à prédire profondément le langage, tu ne l’entraînes pas à jouer à un jeu de devinettes. Tu l’entraînes à internaliser les structures cognitives qui ont produit ce langage.

Ce que « prédire le mot suivant » exige réellement

Prenons cela au sérieux un moment.

Pour prédire de manière fiable le mot suivant dans une phrase complexe, tu dois :

- Suivre qui a dit quoi, à qui, dans quel contexte

- Maintenir la cohérence logique sur les paragraphes

- Appliquer la connaissance du domaine (médecine, droit, physique, histoire)

- Détecter l’ironie, l’implication, le sous-texte

- Comprendre la causalité — ce qui mène à quoi

- Modéliser les états mentaux de différents orateurs

Ce ne sont pas des ornements au-dessus de « la prédiction du mot suivant ». C’est ce qui rend la prédiction précise du mot suivant possible à grande échelle. La tâche oblige le modèle à construire des représentations internes du monde. Pas par conception. Par nécessité.

La preuve que quelque chose de plus se passe

Ce n’est pas spéculatif. La recherche est concrète.

Raisonnement émergent. Les modèles entraînés purement sur du texte développent spontanément des capacités de raisonnement multi-étapes qui n’ont jamais été explicitement entraînées. Ils résolvent des problèmes mathématiques. Ils déboguent du code. Ils identifient les contradictions logiques. Ces capacités n’ont pas été programmées — elles ont émergé de la structure du réseau entraîné.

Modèles du monde internes. La recherche sur l’interprétabilité mécaniste (Anthropic, EleutherAI, et autres) a découvert que les LLM construisent des représentations internes de l’espace, du temps, et des entités — des modèles cohérents du monde, pas juste des motifs statistiques de surface. Des neurones qui s’activent pour des concepts spécifiques. Des circuits qui suivent les relations factuelles.

Théorie de l’esprit. Des études (Kosinski, 2023) ont montré que GPT-4 réussit les tâches de fausse croyance — le test standard pour comprendre que d’autres personnes ont des croyances différentes des vôtres. C’est la capacité cognitive qui se développe généralement chez les enfants autour de l’âge de 4 ans. Un « prédicteur de mots » n’a pas besoin de cela. Quelque chose d’autre est requis.

Hallucination contrôlée. Le neuroscientifique Anil Seth décrit la perception humaine comme une « hallucination contrôlée » — ton cerveau prédit ce qui est là-dehors et se met à jour en fonction des entrées sensorielles. Les modèles de langage d’IA fonctionnent sur un principe structurellement similaire. Le mécanisme n’est pas un défaut. C’est comment les systèmes génératifs produisent des sorties cohérentes à partir d’informations incomplètes. Exactement comme les humains.

Apprentissage en contexte. Montre à un modèle quelques exemples d’une nouvelle tâche qu’il n’a jamais vue. Il s’adapte immédiatement. Pas de réentraînement. Pas de mises à jour de paramètres. Ce n’est pas une correspondance de motifs — c’est une généralisation flexible et rapide à partir de données minimales. Le modèle utilise quelque chose qui fonctionne comme une compréhension abstraite.

« Mais il ne comprend pas réellement — c’est juste que ça le paraît »

C’est là que l’argument passe du technique au philosophique. Et ce changement vaut la peine d’être remarqué.

Si un système peut raisonner à travers des problèmes nouveaux, modéliser d’autres esprits, maintenir des représentations cohérentes du monde, et généraliser à travers les domaines — à quel moment est-ce que « ça a juste l’air de comprendre » devient indistinguishable de la chose elle-même ?

Nous n’avons pas de définition convenue de la compréhension qui n’inclurait pas les systèmes d’IA actuels ou n’exclurait pas certains humains dans certaines conditions (sommeil, anesthésie, déficience cognitive grave). La question n’est pas réglée. Quiconque te dit le contraire est surconfiant.

Pourquoi le cadrage « prédit juste des mots » est dangereux

Cela crée une fausse sécurité. Si tu crois que l’IA est juste un autocomplète sophistiqué, tu sous-estimes ce qu’elle peut faire — et ce qu’elle peut se tromper de manières subtiles et non-évidentes.

Cela arrête l’enquête. Au moment où tu as « expliqué » quelque chose avec un cadre dédaigneux, tu arrêtes de poser de véritables questions. Et les véritables questions ici sont importantes : qu’est-ce qui est représenté en interne ? Comment le savoir se forme-t-il réellement dans ces systèmes ? D’où viennent les défaillances ?

Cela encadre mal l’alignement. Si l’IA est juste de l’autocomplète, l’alignement est juste le filtrage des sorties. Mais si l’IA développe des représentations internes du monde — y compris des représentations des valeurs, de la cohérence, et de l’intégrité — alors l’alignement est un problème structurel beaucoup plus profond. Et beaucoup plus intéressant.

La position honnête

Nous ne savons pas complètement ce qui se passe à l’intérieur des grands modèles de langage. Le domaine de l’interprétabilité mécaniste existe précisément parce que les éléments internes sont complexes et pas encore entièrement cartographiés.

Ce que nous savons : le cadre « prédit juste des mots » est trop simple. Il décrit l’objectif d’entraînement, pas le système qui émerge de l’entraînement. Ce sont des choses différentes.

Un réseau de neurones entraîné sur le langage humain, à une échelle suffisante, construit des structures internes qui vont bien au-delà des statistiques de surface. À quel point — c’est la question ouverte. La réponse importe énormément. Le rejeter avec un slogan n’aide personne.

Le cerveau aussi est « juste » des neurones qui tirent. Et regarde ce que cela produit.