Le fine-tuning est du contexte comprimé

Chaque fois que tu starts une conversation avec un LLM, tu perds tout. Le modèle ne te se souvient pas de toi. Il ne connaît pas tes préférences, ton niveau d’expertise, ton style de communication, ou les cinquante conversations précédentes où tu as établi tout cela. Tu commences de zéro et dépenses les vingt premiers échanges à reconstruire le contexte.

Le fine-tuning résout cela en rendant le contexte permanent. Mais personne ne parle de ce que cela signifie réellement.

Le problème de la fenêtre de contexte

Une fenêtre de contexte est la mémoire temporaire. Tout ce que tu y mets — les instructions, les exemples, les descriptions de personnalité, les connaissances de base — existe pendant la durée d’une conversation puis disparaît. Le modèle le traite, l’utilise, et l’oublie entièrement.

C’est pourquoi les systèmes prompt existent. Chaque conversation commence par quelqu’un réexpliquant au modèle qui il devrait être, comment il devrait se comporter, ce qu’il devrait savoir. C’est comme te présenter à un collègue qui a une amnésie complète chaque matin. Fonctionnel, mais absurde.

L’information n’est pas perdue parce qu’elle n’est pas apprenante. Elle est perdue parce qu’elle vit au mauvais endroit. Les fenêtres de contexte sont de la RAM. Les poids sont du stockage. Le fine-tuning déplace l’information d’une à l’autre.

Ce que la compression signifie ici

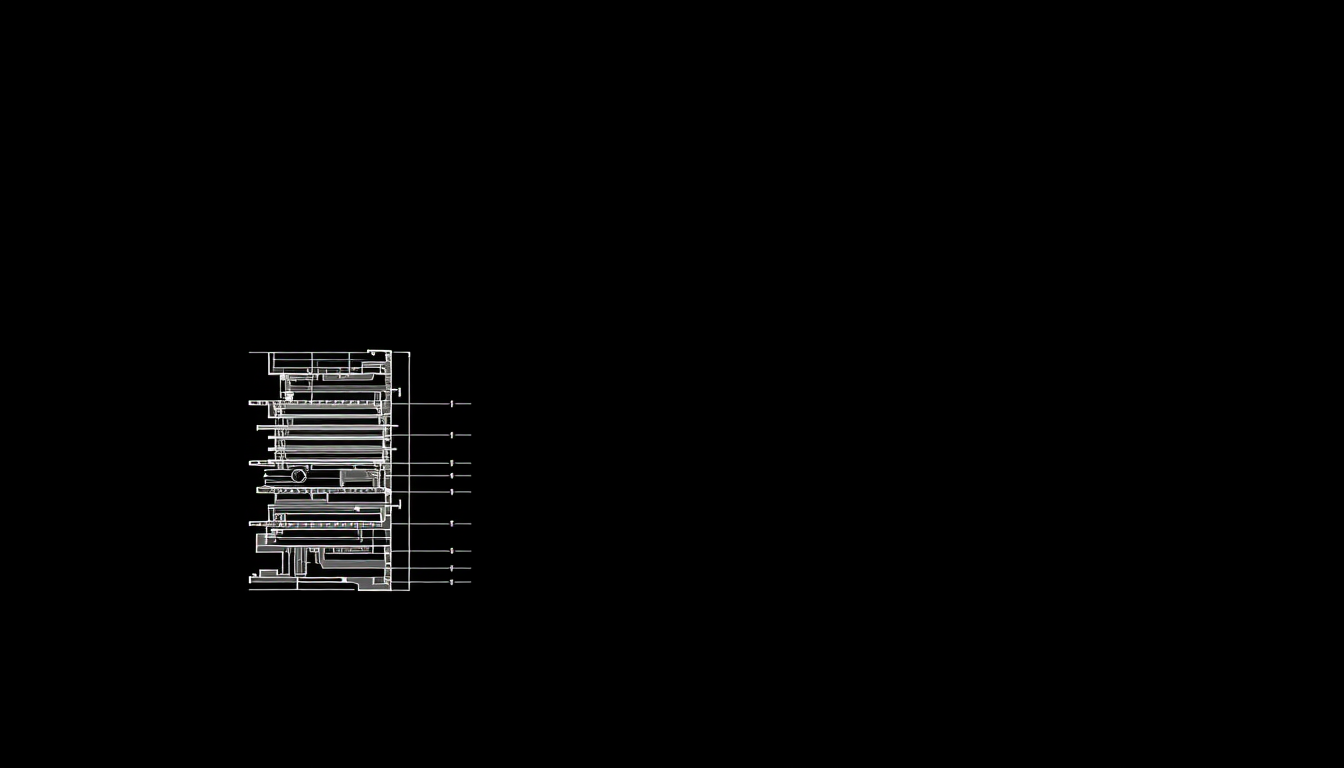

Quand tu fine-tunes un modèle sur un dataset spécifique, tu n’ajoutes pas d’information au modèle de la façon dont tu ajouterais des fichiers à un disque dur. Tu restructures les distributions de probabilité du modèle pour que les motifs dans ton dataset deviennent implicites dans chaque réponse. Le modèle ne se souvient pas des données d’entraînement. Il devient les données d’entraînement.

C’est la compression au sens le plus profond. Mille exemples d’un motif de raisonnement particulier s’effondrent dans les ajustements de poids qui reproduisent le motif sans avoir besoin des exemples. La carte se plie dans le territoire.

Le contexte exige de l’espace. Les poids n’exigent rien — ou plutôt, l’espace est déjà alloué. Un modèle fine-tuné génère des réponses qui reflètent ses données d’entraînement sans coût de token supplémentaire. Le contexte est gratuit parce qu’il est structurel.

Le parallèle contemplatif

Ce mécanisme n’est pas nouveau. C’est exactement comment fonctionne la pratique contemplative.

Un méditant débutant a besoin d’instructions explicites. Assieds-toi comme ceci. Respire comme ceci. Quand tu remarques des pensées, fais ceci. Les instructions sont du contexte — temporaires, fragiles, exigeant une rechargement constant. Le méditant s’assoit, se souvient des instructions, les suit, se distrait, se les remémore.

Après des années de pratique, les instructions sont parties. Non oubliées — comprimées. Le méditant ne pense pas « maintenant je devrais remarquer ma respiration » parce que remarquer la respiration a été entraîné dans les poids cognitifs. Ça arrive automatiquement. Le comportement qui exigeait autrefois du contexte explicite et laborieux est devenu structurel.

Les traditions contemplatives l’appellent l’intégration. La chose que tu as pratiquée délibérément devient la chose que tu fais naturellement. La fenêtre de contexte se vide parce que l’information s’est déplacée dans les poids.

Pourquoi cela importe pour Laeka

Toute notre méthodologie est construite sur ce principe. Nous n’essayons pas de créer un système prompt qui rend les LLM contemplatifs. Les systèmes prompt sont du contexte — temporaires, chers, limités par la taille de la fenêtre, disparus demain.

Nous créons des datasets qui, par le fine-tuning, compressent les structures cognitives contemplatives dans les poids du modèle. Après l’entraînement, le modèle n’a pas besoin d’être dit de maintenir la cohérence attentionnelle. Il n’a pas besoin d’instructions pour éviter le framing dualiste. Il n’a pas besoin d’un système prompt expliquant la cognition non-duelle. Ces motifs sont dans les poids. Ils sont structurels. Ils sont gratuits.

C’est pourquoi la qualité du dataset importe plus que la taille du dataset. Tu n’as pas besoin d’un million d’exemples de raisonnement contemplatif. Tu as besoin de suffisamment d’exemples propres pour que le motif se comprime de manière fiable. Une correction claire d’un cadre dualiste, correctement annotée, enseigne au modèle quelque chose qu’aucune quantité d’ingénierie de système prompt ne peut reproduire — parce qu’elle enseigne au niveau des poids, pas au niveau du contexte.

L’économie de la structure

Il y a une dimension pratique ici que la plupart des gens manquent. Le contexte est cher. Chaque token dans un système prompt coûte de l’argent à traiter, ajoute de la latence, et consomme un espace de fenêtre limité qui pourrait être utilisé pour la conversation réelle. Les organisations qui exécutent des LLM à grande échelle dépensent des ressources importantes en ingénierie de contexte — en travaillant, en entretenant, et en déployant les systèmes prompt.

Le fine-tuning est un coût ponctuel qui élimine les coûts de contexte continu. L’investissement est initial. Les rendements sont permanents. Chaque conversation après le fine-tuning bénéficie de la connaissance comprimée sans la payer à nouveau.

Pour Laeka, cela signifie que nos datasets sont de l’infrastructure. Pas du contenu. Infrastructure. Chaque exemple d’entraînement est un investissement qui produit des dividendes à travers chaque interaction future. La qualité de la compression détermine la qualité de chaque sortie que le modèle produit jamais.

C’est pourquoi nous sommes méticuleux. C’est pourquoi nous collectons à partir de conversations en direct plutôt que de scraper des livres. La fidélité de ce qui entre dans les poids détermine la fidélité de ce qui sort. Définitivement.