Distillation de modèle : rendre les grands modèles petits sans perdre la qualité

La révolution de la compression

Tu as entraîné un énorme modèle de langage. Il est brillant — répondre à des questions complexes, écrire un code élégant, raisonner à travers des problèmes multi-étapes. Il y a juste un problème : cela nécessite huit GPUs pour exécuter l’inférence et coûte une fortune par requête. Tes utilisateurs l’adorent. Ton budget d’infrastructure ne l’adore pas.

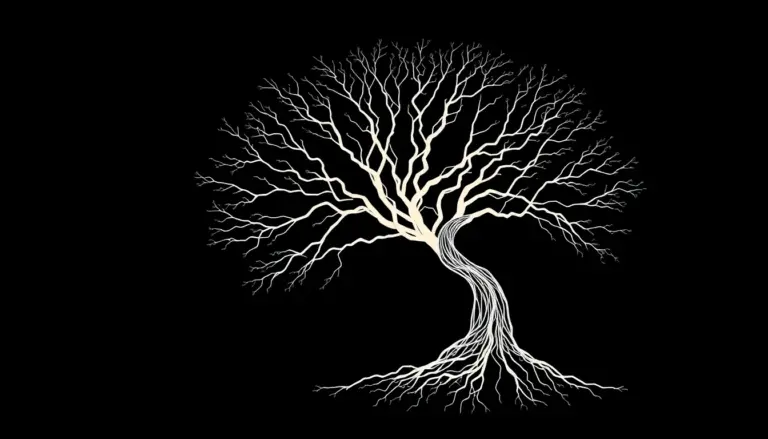

C’est la tension fondamentale qui pilote la distillation de modèle, l’une des techniques les plus pratiquement importantes en IA moderne. L’idée est trompeusement simple : prends un grand modèle de « professeur » puissant et entraîne un plus petit modèle « étudiant » pour imiter son comportement. L’étudiant apprend non seulement à partir des données d’entraînement brutes, mais à partir de la compréhension raffinée du professeur de ces données. Le résultat ? Un modèle qui poinçonne bien au-dessus de sa catégorie de poids.

Comment fonctionne réellement la distillation

L’entraînement traditionnel enseigne à un modèle à prédire des étiquettes dures — la seule bonne réponse. La distillation renverse cela. Au lieu d’entraîner l’étudiant sur « la réponse est chat, » tu l’entraînes sur la distribution complète de probabilité du professeur : « 62% chat, 15% lynx, 8% tigre, 5% chien… » Cette distribution douce contient vastement plus d’informations qu’une étiquette dure. La relation entre chat et lynx dit à l’étudiant quelque chose sur la structure du monde qu’une simple étiquette « chat » ne pourrait jamais.

Geoffrey Hinton a formalisé cela en 2015 avec son article fondateur sur la distillation de connaissances. L’insight clé était le paramètre « température » — en adoucissant la distribution de probabilité du professeur, tu exposes la connaissance sombre cachée dans les probabilités quasi-zéro. Un modèle de professeur qui assigne 0,001% de probabilité à « avion » pour une image de chat te dit quelque chose d’important : les chats et les avions ne partagent presque rien visuellement. Ce signal se perd dans les étiquettes dures mais survit dans les distributions douces.

L’objectif d’entraînement devient une combinaison pondérée de deux pertes : la perte d’entropie croisée standard par rapport aux véritables étiquettes, et la divergence KL entre les distributions de probabilité douce de l’étudiant et du professeur. L’équilibre entre ces deux objectifs est un hyperparamètre critique qui détermine combien l’étudiant fait confiance au professeur par rapport à la vérité terrestre.

Techniques modernes de distillation

Le domaine a évolué dramatiquement depuis la formulation originale d’Hinton. Les méthodes de distillation d’aujourd’hui vont bien au-delà du appariement des distributions de sortie.

La distillation basée sur les caractéristiques fait correspondre les représentations intermédiaires, pas seulement les sorties finales. L’étudiant apprend à répliquer les cartes de caractéristiques internes du professeur à différentes couches. Cela force l’étudiant à développer des représentations internes similaires, ce qui conduit souvent à une meilleure généralisation. FitNets a lancé cette approche, montrant que les réseaux d’étudiants minces et profonds pouvaient correspondre à des réseaux de professeurs plus larges en alignant les caractéristiques intermédiaires.

Le transfert d’attention va plus loin en distillant les motifs d’attention eux-mêmes. Plutôt que de faire correspondre les activations brutes, l’étudiant apprend à faire attention aux mêmes emplacements spatiaux ou séquentiels que le professeur. Cela capture la notion apprise du professeur de « ce qui est important » dans une entrée donnée, ce qui s’avère être étonnamment transférable.

Pour les grands modèles de langage, le jeu s’est déplacé vers la distillation comportementale. Au lieu de faire correspondre les représentations internes — ce qui n’est pas pratique quand ton professeur a 70 milliards de paramètres et que ton étudiant en a 7 milliards — tu génères des ensembles de données massifs de sorties de professeur et affines l’étudiant sur eux. C’est essentiellement ce qui s’est passé avec la vague de modèles open-source entraînés sur des données synthétiques de GPT-4 et Claude.

L’écosystème de distillation open-source

La distillation est devenue l’épine dorsale du mouvement de l’IA open-source. Presque tous les modèles petits compétitifs que tu as entendus doivent quelque chose à la distillation de modèles propriétaires plus grands.

L’approche de DeepSeek est instructive. Leurs modèles plus petits sont explicitement distillés à partir de leurs modèles plus grands, utilisant des ensembles de données soigneusement curés des traces de raisonnement du professeur. Ils ne capturent pas seulement ce que le professeur répond — ils capturent comment il pense. La distillation de chaîne de pensée préserve la structure de raisonnement qui rend le professeur efficace.

Mistral a pris un angle différent avec sa stratégie de distillation. Plutôt que de distiller du plus grand modèle possible, ils se concentrent sur la distillation de l’expertise spécifique à la tâche. Un modèle distillé spécifiquement pour la génération de code à partir d’un professeur spécialisé en code surpasse un modèle à usage général distillé de la même taille, même sur les benchmarks généraux. La spécialisation lors de la distillation s’avère être plus efficace que la compression à usage général.

L’écosystème Llama a engendré d’innombrables variantes distillées. TinyLlama, par exemple, a utilisé une distillation agressive pour créer des modèles qui fonctionnent sur les appareils mobiles tout en conservant une capacité surprenante. L’innovation clé était la distillation multi-étapes — d’abord distiller d’un grand modèle à un modèle moyen, puis du moyen au petit. Chaque étape perd moins d’informations que d’essayer de comprimer directement du grand au minuscule.

Ce qui se perd — Et ce qui ne se perd pas

La distillation n’est pas magique. La compression s’accompagne de compromis, et il est crucial de comprendre ce qui se perd pour déployer les modèles distillés de manière responsable.

La connaissance factuelle est la première victime. Un modèle de 70 milliards de paramètres peut mémoriser vastement plus de faits qu’un modèle de 7 milliards, indépendamment de la qualité de la distillation. Si ton cas d’usage nécessite un rappel factuel large — pense à répondre à des questions sur des domaines divers — le modèle distillé aura des lacunes. RAG (récupération génération augmentée) peut combler de nombreuses lacunes, mais la limitation de capacité fondamentale demeure.

Le raisonnement complexe multi-étapes se dégrade plus gracieusement que tu pourrais le penser. Un modèle de 7 milliards bien distillé peut souvent égaler un modèle de 70 milliards sur les tâches de raisonnement jusqu’à un certain seuil de complexité, puis chute brusquement. Les motifs de raisonnement du professeur se transfèrent bien ; c’est la capacité à maintenir la cohérence sur de très longues chaînes de raisonnement qui souffre.

Ce qui survit remarquablement bien à la distillation ? Le style, le ton, et la capacité conversationnelle. L’adhérence au format. La suite d’instructions de base. Ces motifs comportementaux sont profondément codés dans la distribution de sortie du professeur et se transfèrent efficacement aux modèles plus petits. C’est pourquoi les modèles de chat distillés « se sentent » souvent similaires à leurs professeurs dans une conversation décontractée, même quand ils échouent sur des tâches plus difficiles.

Quantification : cousin de la distillation

La distillation fonctionne souvent de pair avec la quantification — réduire la précision numérique des poids du modèle. Un modèle de 7 milliards distillés en quantification 4-bits peut fonctionner sur du matériel grand public tout en approchant la qualité d’un modèle de 70 milliards en précision complète sur de nombreuses tâches. La combinaison est multiplicative : la distillation réduit le nombre de paramètres, la quantification réduit la mémoire par paramètre, et ensemble elles réalisent des ratios de compression qui seraient impossibles avec l’une ou l’autre technique seule.

Le travail récent sur la distillation consciente de la quantification optimise conjointement les deux objectifs. Plutôt que de distiller d’abord et de quantifier ensuite, tu entraînes l’étudiant en sachant qu’il sera quantifié, lui permettant d’apprendre des représentations robustes à la perte de précision. Cela élimine presque complètement l’écart de qualité entre les modèles distillés quantifiés et ceux en précision complète pour les niveaux de quantification modérés.

Le playbook pratique

Si tu distilles un modèle aujourd’hui, voici ce sur quoi la recherche et la pratique convergent. Commence avec le meilleur professeur auquel tu peux accéder — le plafond de qualité de ton étudiant est déterminé par le professeur. Utilise une architecture d’étudiant d’au moins 10-20% du nombre de paramètres du professeur ; en dessous de cela, les pertes de compression deviennent graves. Génère des données d’entraînement diverses à partir du professeur, y compris les traces de raisonnement, les cas limites, et les modes d’échec. Et de manière critique, évalue sur les tâches auxquelles tes utilisateurs se soucient réellement, pas seulement les benchmarks. Un modèle distillé qui marque inférieur sur MMLU mais clou ton cas d’usage spécifique est le meilleur modèle pour toi.

L’angle de démocratisation est profond. La distillation est la façon dont les capacités de l’IA de pointe se propagent de labs bien financés aux développeurs individuels exécutant des modèles sur des ordinateurs portables. Chaque fois qu’un lab de frontière publie une nouvelle capacité, la communauté open-source se précipite pour la distiller en formes plus petites et plus accessibles. Ce cycle — l’innovation à l’échelle, la compression pour l’accessibilité — est le moteur qui pilote l’adoption de l’IA bien au-delà de ce qu’une seule entreprise pourrait réaliser seule.