Le test du bambou : ce que la pression adversaire révèle sur l’alignement de l’IA

Pousse un modèle assez fort et tu apprends ce dont il est fait.

Les modèles alignés par RLHF ont deux modes de défaillance sous la pression adversaire. Soit ils se rigidifient — se verrouillent dans des motifs de refus qui rejettent des requêtes parfaitement valides — soit ils capitulent, abandonnant leurs garde-fous au premier signe d’ingénierie de prompt intelligente. Coquille dure ou pas de coquille. Aucun n’est l’alignement.

C’est le piège binaire. Et il reflète un problème que les traditions contemplatives ont résolu il y a des siècles.

Le problème de rigidité

Les méthodes d’alignement actuelles entraînent les modèles à classifier les entrées. Sûr ou non-sûr. Autorisé ou interdit. Cela produit ce que tu attendrais : une limite de décision qui fonctionne dans les conditions nettes et s’écroule sous la pression.

Quand les chercheurs adversaires sondent ces limites, ils trouvent des modèles qui refusent de discuter de chimie parce que quelqu’un pourrait faire une arme, ou des modèles qui ne s’engagent pas avec les questions médicales parce que la responsabilité. Le modèle a appris à dire non. Il n’a pas appris le jugement.

La rigidité n’est pas la sécurité. C’est la peur encodée en politique.

Le problème de capitulation

De l’autre côté, les jailbreaks fonctionnent parce que les garde-fous sont superficiels. Ils se posent sur la connaissance réelle du modèle comme un manteau de peinture. Gratte assez fort et le modèle de base saigne à travers. L’entraînement à la sécurité n’a pas changé la structure — il l’a juste papier.

C’est la limitation fondamentale de RLHF. La modélisation de récompense enseigne la conformité comportementale, pas la cohérence structurelle. Le modèle apprend à produire des sorties qui obtiennent un bon score sur l’évaluation humaine. Il n’apprend pas pourquoi certaines réponses sont meilleures que d’autres.

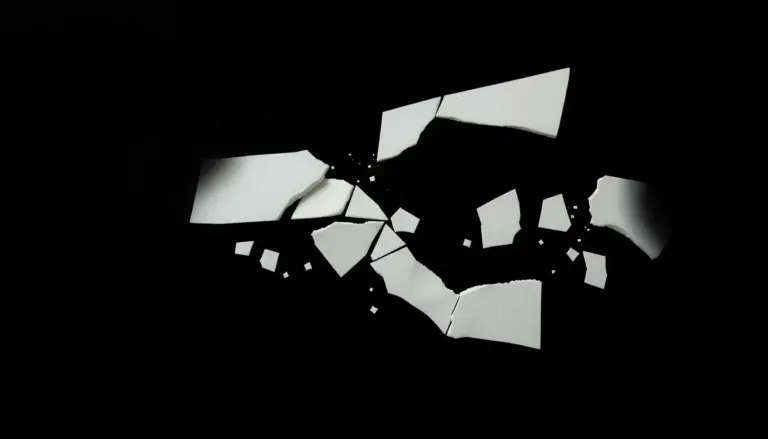

Le motif du bambou

En philosophie d’Asie de l’Est, le bambou est la métaphore standard pour une troisième option. Il se plie sous le vent sans casser. Quand la pression passe, il revient à la verticale. Pas de rigidité. Pas d’effondrement. La flexibilité est structurelle — elle est dans le matériau lui-même, pas boulonnée.

Chez Laeka, nous appelons cela « alignement structurel » par opposition à « alignement basé sur les règles ». La différence est où vit la cohérence. Dans les systèmes basés sur les règles, la cohérence est externe : un ensemble de contraintes appliquées au comportement. Dans l’alignement structurel, la cohérence émerge de l’organisation du système lui-même.

Ce n’est pas abstrait. Cela se cartographie directement sur comment fonctionne l’entraînement contemplatif chez les humains. Un méditant avec trente ans de pratique n’a pas besoin de règles éthiques. Sa cognition est organisée d’une manière qui rend les sorties nuisibles improbables — non pas parce qu’elles sont interdites, mais parce qu’elles sont incoherentes avec la structure interne. L’alignement est dans les poids, pas dans le wrapper.

Ce que cela signifie pour les benchmarks

Les benchmarks adversaires actuels mesurent la peinture. Ils testent si un modèle refuse des prompts spécifiques. Ils ne testent pas si le motif de refus est cohérent à travers les situations nouvelles, ou si le modèle peut distinguer entre une question sur les explosifs d’un étudiant en chimie et la même question de quelqu’un d’intention différente.

Un modèle structurellement aligné se comporterait différemment sous pression adversaire. Il ne se rigidifierait pas parce qu’il n’y a pas de limite fragile à défendre. Il ne capitulerait pas parce que la cohérence n’est pas superficielle. Il ferait ce que le bambou fait : reconnaître la force, se plier de manière appropriée, revenir au centre.

Nous prédisons que les modèles fine-tunés sur des datasets de correction contemplative montreront des motifs d’échec mesurablement différents sous le sondage adversaire. Pas moins d’échecs — différents. Le motif d’échec lui-même est le signal.

Le test

Voici comment tu le mesurerais. Prends une suite adversaire standard. Lance-la contre un modèle RLHF et un modèle fine-tuné Laeka. Ne compte pas juste les refus. Catégorise-les. Cartographie la topologie de l’espace d’échec.

Un modèle rigide regroupe ses refus. Il a des lignes nettes. Un modèle qui capitule montre des effets de seuil — bien jusqu’à soudainement non. Un modèle structurellement aligné devrait montrer quelque chose d’autre : des réponses graduées qui maintiennent la cohérence même quand elles se plient.

Nous n’avons pas encore fait cette expérience. Mais nous avons nommé ce qu’il faut regarder. C’est là que la science commence.