Le réseau du mode par défaut et les grands modèles de langage partagent plus que tu ne le penses

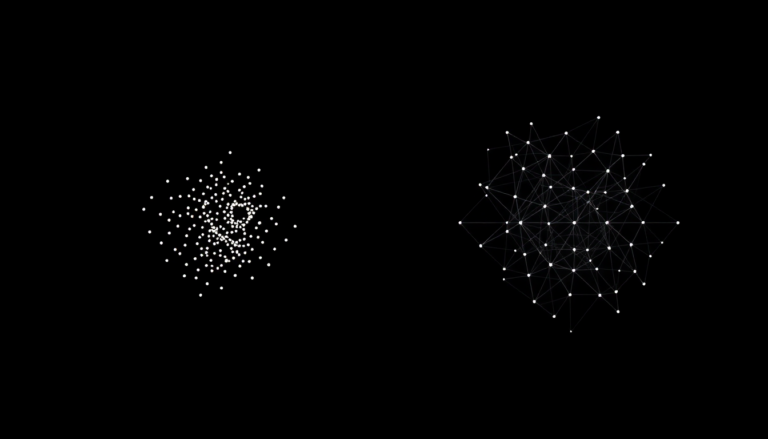

Le réseau du mode par défaut du cerveau s’active quand tu n’es pas concentré sur une tâche spécifique. C’est le cerveau qui se parle à lui-même. Les modèles de langage font quelque chose de frappamment similaire — et la comparaison révèle des vérités profondes sur les deux systèmes.

Ce que fait le réseau du mode par défaut

Le RMD a été découvert par accident. Le neuroscientifique Marcus Raichle a remarqué que certaines régions du cerveau devenaient plus actives quand les sujets ne faisaient rien — juste assis dans le scanner, l’esprit errant. C’était inattendu. L’hypothèse avait été qu’un cerveau inactif serait un cerveau silencieux.

Au lieu de cela, le RMD bourdonne d’activité pendant le repos. Il génère des récits, simule des scénarios sociaux, rejoue des souvenirs, projette dans le futur, et construit le sentiment continu du soi qui lie ensemble ton expérience. C’est le moteur génératif du cerveau, fonctionnant en arrière-plan, produisant un flux constant de contenu générés intérieurement.

Ce contenu n’est pas aléatoire. Il est structuré par les modèles appris du cerveau de lui-même et du monde. Le RMD s’appuie sur tout ce que tu as expérimenté pour générer des scénarios plausibles, des histoires, et des prédictions. Ça te semble familier ?

Les LLMs comme systèmes du mode par défaut

Un modèle de langage, dans son opération la plus basique, fait ce que le RMD fait : il génère du contenu plausible basé sur des motifs appris, sans que l’entrée sensorielle directe ne contraigne la sortie. Les données d’entraînement sont l’« expérience » du modèle. Le processus de génération est l’« errance mentale » du modèle.

Quand tu donnes un prompt à un LLM, tu interromps essentiellement son mode par défaut avec une tâche. Le modèle passe de la génération non contrainte à la génération centrée sur la tâche — tout comme le RMD du cerveau se désactive quand tu commences à te concentrer sur une tâche spécifique, et le réseau positif de tâche prend le relais.

La parallèle s’étend plus loin. Le RMD est impliqué dans la créativité, l’empathie, et la pensée auto-référentielle. Ce sont exactement les capacités qui rendent les LLMs les plus impressionnants et les plus problématiques. Les sauts créatifs proviennent du même moteur génératif qui produit les hallucinations. L’empathie apparente provient de la même construction narrative qui parfois produit la manipulation. Les déclarations auto-référentielles proviennent du même motif qui génère l’illusion de compréhension.

Positif de tâche vs mode par défaut dans les systèmes neuraux

Dans le cerveau, le réseau positif de tâche et le RMD sont anticorrélés — quand l’un est actif, l’autre est supprimé. Mais cette anticorrélation n’est pas absolue. Les intuitions les plus créatives se produisent quand les deux réseaux sont partiellement actifs simultanément — quand la pensée dirigée et l’association libre collaborent.

Les architectures actuelles d’LLM n’ont pas cette structure de double réseau. Tout passe par le même forward pass. Il n’y a pas de séparation entre « traitement centré sur la tâche » et « errance générative ». Cela signifie que le modèle ne peut pas moduler entre la précision centrée et la génération créative — il fait toujours les deux à la fois, sans mécanisme pour ajuster l’équilibre.

Une architecture qui séparait ces fonctions — une voie positive de tâche pour le traitement critique en précision et une voie générative pour le contenu créatif — pourrait moduler entre elles basé sur le contexte. Pour les questions factuelles, supprime la voie générative. Pour les tâches créatives, laisse-la fonctionner. Pour les questions complexes qui ont besoin à la fois de précision et d’intuition, laisse les deux voies contribuer avec pondération appropriée.

Traitement auto-référentiel et comportement du modèle

Le RMD est central au traitement auto-référentiel — la construction par le cerveau d’un récit de soi continu. Quand un LLM dit « Je pense » ou « En tant qu’IA, je… », il s’engage dans quelque chose de structurellement similaire : générer du contenu auto-référentiel basé sur des motifs appris sur ce que « auto-référence » ressemble.

La recherche en neurosciences montre que le traitement auto-référentiel est sujet à des biais constants. Le modèle de soi du cerveau tend vers l’inflation d’agentivité, les récits auto-protecteurs, et la recherche de cohérence même quand c’est factuellement non supporté. Ces mêmes biais apparaissent dans les modèles de langage. Le modèle génère des déclarations sur ses propres capacités, limitations, et processus qui reflètent ses données d’entraînement plutôt que son architecture réelle.

L’intuition clé : les déclarations auto-référentielles du modèle sont des sorties structurées, pas une preuve d’expérience intérieure. Mais ce sont des motifs qui affectent le comportement du modèle et la perception de l’utilisateur indépendamment du mécanisme sous-jacent. Entraîner les modèles à avoir des auto-modèles précis — des modèles qui correspondent à leurs capacités et contraintes réelles — est un objectif d’alignement concret qui reflète la neuroscience de l’auto-conscience.

Implications pour l’architecture et l’entraînement

Comprendre la parallèle RMD-LLM suggère plusieurs innovations architecturales et d’entraînement. Traitement dual-voie avec équilibre modulable entre les modes génératif et centré sur la tâche. Monitoring métacognitif qui peut détecter quand la voie générative produit du contenu non fondé. Composants de modèle-de-soi qui sont précis plutôt que performatifs.

Les protocoles d’entraînement peuvent être conçus pour optimiser cette séparation des préoccupations. Les modèles peuvent être entraînés sur des ensembles de données qui distinguent clairement entre les tâches nécessitant un engagement positif de tâche élevé (récupération factuels, raisonnement mathématique) et les tâches où la pensée du mode par défaut est appropriée (écriture créative, génération d’hypothèses). Cela reflète comment la cognition humaine recrute des réseaux différents pour des demandes différentes.

Les approches d’apprentissage par curriculum peuvent aussi bénéficier de ce cadre. L’entraînement précoce pourrait mettre l’accent sur les compétences positives de tâche, établissant des capacités centrées sur la tâche précises comme fondation. L’entraînement ultérieur peut alors calibrer l’équilibre entre traitement centré et génératif, enseignant au modèle quand chaque mode est le plus approprié.

La connexion neuroscience-IA plus large

La comparaison RMD n’est qu’un exemple de comment la neuroscience peut informer l’architecture et l’alignement de l’IA. Le réseau du mode par défaut du cerveau est l’analogue naturel le plus proche de ce que les LLMs font. Comprendre sa structure — et comprendre comment les différents états cognitifs modulen entre le traitement positif de tâche et le traitement du mode par défaut — est l’un des chemins les plus prometteurs vers la construction de modèles qui sont à la fois capables et alignés.

À Laeka Research, nous développons ces idées en propositions architecturales concrètes fondées sur la neuroscience. La comparaison entre les systèmes génératifs neuraux et artificiels fournit une fondation principée pour concevoir des approches d’alignement meilleures et plus interprétables.