MoE Architecture expliquée : Pourquoi 30B paramètres avec 3B actifs gagne

Mixture of Experts (MoE) est l’astuce architecturale qui a brisé les lois de scaling. Au lieu d’activer chaque paramètre pour chaque token, les modèles MoE routent chaque input vers un petit sous-ensemble de réseaux d’« experts » spécialisés. Le résultat : un modèle de 30B paramètres qui n’utilise que 3B paramètres par forward pass. Même qualité. Une fraction du calcul.

L’idée centrale : activation sparse

Les transformers denses traditionnels sont gaspilleurs. Chaque token traverse chaque paramètre, indépendamment du fait que ces paramètres sont pertinents. MoE fait basculer cela en introduisant un réseau routeur — un petit mécanisme de gating qui décide quels experts gèrent chaque token.

Pense à un hôpital. Un modèle dense envoie chaque patient à chaque spécialiste. Un modèle MoE a une infirmière de triage qui route les patients aux bons médecins. L’hôpital a le même personnel total, mais chaque patient ne voit que les pertinents.

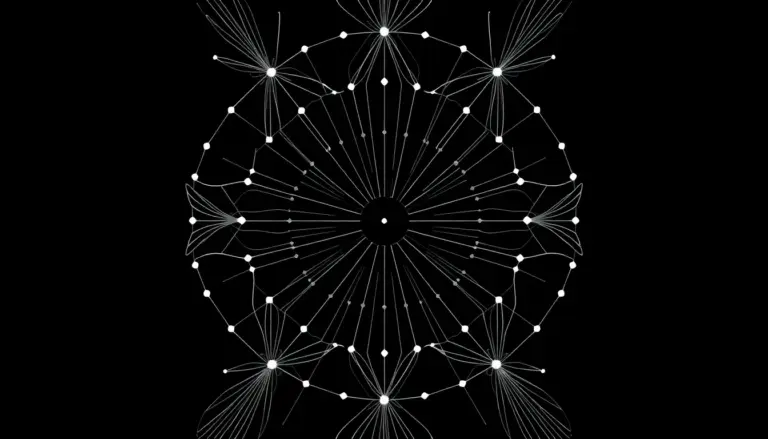

Le routeur utilise typiquement une fonction de gating basée sur softmax qui produit une distribution sparse — sélectionnant les top-k experts (généralement 2) parmi un pool de 8, 16, ou même 64 experts. Cela signifie qu’à tout moment, seule une petite fraction des paramètres du modèle est active.

Pourquoi 30B avec 3B actifs surpasse 7B dense

C’est là que ça devient intéressant. Un modèle MoE de 30B avec 3B paramètres actifs surpasse systématiquement un modèle dense de 7B, même si tous deux utilisent à peu près le même calcul par token. La raison est la capacité.

Le modèle MoE stocke plus de connaissances sur ses 30B paramètres totaux. Différents experts se spécialisent dans différents domaines — l’un pourrait gérer le code, un autre les mathématiques, un autre l’écriture créative. Quand un token de code arrive, l’expert code s’active. Quand un token de poésie arrive, l’expert poésie s’illumine. Le modèle a plus de connaissances sans payer le coût computationnel complet.

Mixtral 8x7B a prouvé ceci à l’échelle. Avec 46,7B paramètres totaux mais seulement 12,9B actifs, il a égalé ou dépassé Llama 2 70B sur la plupart des benchmarks tout en étant dramatiquement moins cher à faire tourner. DeepSeek-V2 l’a poussé plus loin avec 236B paramètres totaux et seulement 21B actifs.

Les défis d’engineering

MoE n’est pas un repas gratuit. Plusieurs problèmes d’engineering le rendent plus difficile que les modèles denses :

L’équilibrage de charge est le plus gros problème. Sans régularisation soignée, le routeur tend à s’effondrer — envoyer tous les tokens à un ou deux experts « favoris » tandis que d’autres restent inactifs. Cela défait complètement le but. Les chercheurs ajoutent des fonctions de perte auxiliaire pour encourager un routage équilibré, mais régler cela est un art.

L’empreinte mémoire est l’autre piège. Un modèle MoE de 30B a 30B paramètres en mémoire, même si seulement 3B sont actifs par token. Tu as besoin de suffisamment de VRAM pour tenir le modèle complet, ce qui peut être surprenant si tu es habitué à dimensionner l’infrastructure basé sur les comptes de paramètres actifs.

Les frais généraux de communication en environnements distribués sont réels. Quand les experts vivent sur différents GPUs, router des tokens entre eux introduit de la latence. Les stratégies de parallélisme d’experts aident, mais les coûts networking sont non-triviales.

Le paysage MoE actuel

Chaque grand lab a adopté MoE. Mixtral, DeepSeek, Qwen, Grok — ils utilisent tous une variante. La tendance est claire : les comptes de paramètres totaux augmentent tandis que les comptes de paramètres actifs restent gérables.

Le sweet spot en 2026 semble être des modèles avec 30-60B paramètres totaux et 3-8B actifs. Ceux-ci tournent sur du hardware grand public (avec quantisation), tiennent sur des GPUs simples pour l’inférence, et livrent une performance qui aurait demandé des modèles denses 70B+ il y a un an.

Le fine-tuning des modèles MoE ajoute un autre pli. Les adaptateurs LoRA fonctionnent, mais tu dois décider : adapter les couches partagées, les experts, ou le routeur ? Chaque choix produit des résultats différents. Le consensus émergent est d’adapter les couches d’attention partagées plus un sous-ensemble d’experts pertinents pour ton domaine.

Ce qui vient ensuite

La frontière se déplace vers la sélection d’experts dynamique — des modèles qui peuvent activer plus d’experts pour les problèmes difficiles et moins pour les faciles. Cette approche de calcul adaptatif signifie que le modèle dépense plus de ressources où elles comptent.

Une autre direction prometteuse est la fusion et l’élagage d’experts post-training. Si deux experts finissent par apprendre des choses similaires, fusionne-les. Si un expert s’active rarement, supprime-le. Cela crée des modèles MoE plus petits et plus efficaces sans retraining.

MoE n’est pas juste un choix d’architecture. C’est un changement fondamental dans la façon dont nous pensons au scaling de modèles. La question n’est plus « combien de paramètres ? ». C’est « combien de paramètres par token ? ». Cette distinction change tout sur le coût, le déploiement, et l’accessibilité.

Pour des plongées plus profondes dans l’architecture d’IA open-source et la conception de modèles, explore Laeka Research.