L’IA et la Loi 25 : guide de conformité pour professionnels

La Loi 25 sur la protection des renseignements personnels est en vigueur depuis peu au Québec, et elle impose de nouvelles obligations importantes pour les organisations qui utilisent l’intelligence artificielle. À titre de consultant en transformation IA, je vous guide à travers les enjeux clés et les mesures concrètes à mettre en place.

Comprendre la Loi 25 et ses implications pour l’IA

La Loi 25 renforce considérablement la protection des données personnelles et introduit plusieurs nouvelles exigences. Pour les organisations utilisant l’IA, cela signifie une responsabilité accrue quant à la provenance des données, leur utilisation et leur conservation. Les systèmes d’IA, qu’ils soient développés en interne ou acquis auprès de fournisseurs externes, doivent respecter des standards de conformité plus stricts.

Prenons l’exemple d’une institution financière québécoise qui déploie un chatbot pour le service à la clientèle. Si ce système traite des données personnelles—noms, numéros de compte, historiques de transactions—il doit être conforme à la Loi 25. Cela inclut la documentation explicite du consentement, la minimisation des données collectées et la capacité à honorer les demandes d’accès ou de suppression des données.

Cinq piliers de la conformité IA

1. Cartographie des données

Identifiez précisément quelles données personnelles votre système IA traite. Documentez leur source, leur durée de rétention et leurs usages. Une clinique de télémédecine montréalaise, par exemple, doit documenter comment ses algorithmes de diagnostic utilisent les dossiers médicaux.

2. Consentement explicite

Le consentement ne peut plus être implicite. Les utilisateurs doivent savoir qu’une IA analyse leurs données et accepter clairement. Cela s’applique même aux analyses secondaires—si un système IA découvre des patterns nouveaux dans les données, ce nouvel usage peut nécessiter un nouveau consentement.

3. Gouvernance des modèles

Documentez comment votre modèle IA a été entraîné. Quels datasets? Qui les a collectés? Contiennent-ils des données personnelles? Un cabinet juridique qui utilise une IA générative pour analyser des contrats doit assurer que cette IA n’a pas été entraînée sur des données confidentielles de clients.

4. Droits d’accès et de suppression

Les individus ont le droit de demander l’accès à leurs données et leur suppression. Si quelqu’un demande l’effacement de son information, l’organisation doit pouvoir le faire—même si cette donnée était utilisée pour entraîner un modèle IA. Cela pose des défis techniques importants.

5. Évaluation des impacts

Avant de déployer un système IA qui traite des données personnelles, réalisez une évaluation des impacts (AIPD) sur la protection des renseignements. Identifiez les risques et mettez en place des mesures d’atténuation.

Cas pratique : PME manufacturière du Québec

Une PME de Montréal envisage d’implémenter un système IA prédictif pour optimiser sa chaîne d’approvisionnement. Le système analyserait les données des employés (temps de travail, performance) pour mieux planifier la production. Voici comment assurer la conformité:

- Obtenir le consentement des employés avant toute analyse

- Documenter l’usage : expliquer précisément ce que l’IA fait avec les données

- Sécuriser : implémenter le chiffrement et les contrôles d’accès

- Mettre en place un processus pour honorer les demandes d’accès ou de suppression

- Former l’équipe sur les enjeux de conformité

Les défis techniques de la conformité IA

Le plus grand défi? Les modèles IA modernes, particulièrement les grands modèles de langage, sont des « boîtes noires ». Il est souvent difficile d’expliquer précisément comment ils utilisent les données. La Loi 25 exige pourtant une transparence et une traçabilité. Cela signifie que certaines approches « prêtes à l’emploi »—utiliser une API d’IA générative sans vérification—peuvent être risquées d’un point de vue conformité.

Pour un cabinet comptable québécois qui souhaite automatiser la préparation des déclarations fiscales avec l’IA, l’approche la plus sûre serait d’utiliser des modèles locaux qu’on contrôle entièrement, plutôt que des services cloud où on ne sait pas exactement comment les données sont traitées.

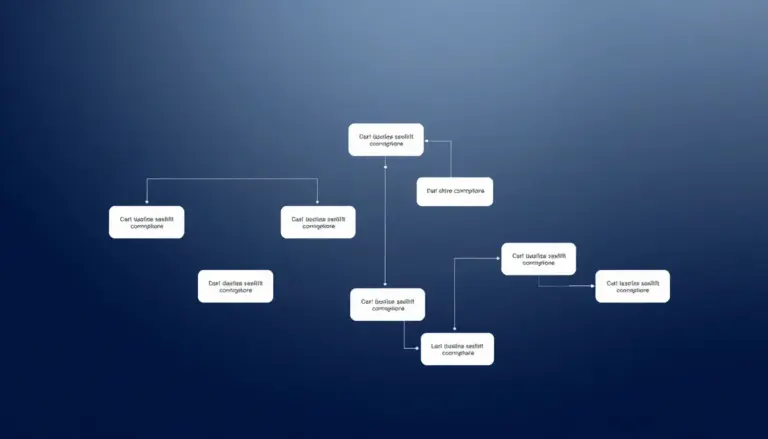

Plan d’action immédiat

- Audit : Identifiez tous les systèmes IA en production et les données qu’ils traitent

- Classification : Catégorisez par niveau de risque (haut, moyen, bas)

- Documentation : Documentez la conformité pour chaque système

- Mise à jour : Mettez en place les mesures manquantes (consentement, processus de suppression, etc.)

- Formation : Sensibilisez votre équipe à la Loi 25

- Suivi : Établissez un processus de conformité continue

Conclusion

La Loi 25 n’est pas un obstacle à l’innovation IA—elle est une opportunité d’instaurer la confiance. Les organisations québécoises qui adoptent la conformité dès maintenant se positionnent comme des leaders responsables. Elles attirent aussi les meilleurs talents et les clients exigeants, pour qui la protection des données est une priorité.

Réservez votre appel découverte de 30 minutes pour discuter de comment assurer la conformité de vos initiatives IA. Visitez laeka.org/services/