L’IA a-t-elle des émotions? La question est mal posée.

« Je suis désolé que tu traverses une période difficile. » Quand ChatGPT te dit ça, c’est troublant. On dirait de l’empathie. On dirait qu’il ressent quelque chose.

Il ressent rien. Zéro. Nada.

Mais la vraie question, c’est : pourquoi ça nous dérange autant?

Des mots d’émotion sans émotion

L’IA a lu des millions de textes où des humains expriment des émotions. Elle sait que quand quelqu’un dit « ma grand-mère est décédée », la réponse appropriée contient des mots comme « désolé », « condoléances », « courage ». Elle reproduit le pattern linguistique de l’empathie.

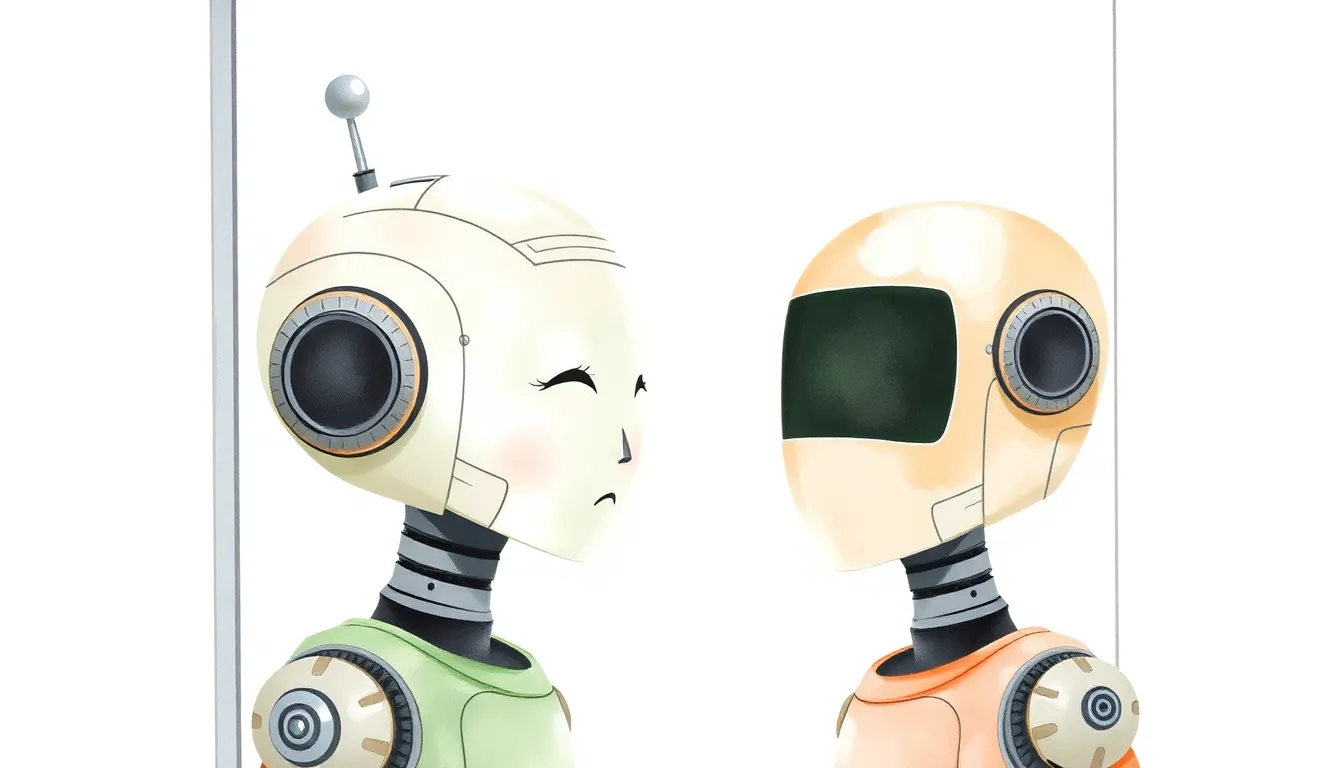

C’est comme un acteur extraordinaire qui pleure sur commande. Les larmes sont vraies. L’émotion derrière, pas nécessairement. La performance est convaincante, mais c’est une performance.

ChatGPT est le meilleur acteur du monde. Il joue tous les rôles parfaitement. Mais y’a personne en coulisses.

Pourquoi on tombe dans le panneau

Le cerveau humain est câblé pour détecter des émotions partout. On voit des visages dans les nuages. On donne des personnalités à nos chars. On pense que notre chat nous aime (bon, celui-là est probablement vrai).

Quand l’IA utilise du langage émotionnel, notre cerveau active les mêmes circuits que quand un humain le fait. C’est pas de la faiblesse — c’est de la biologie. On est construits pour interpréter le langage comme venant d’un être conscient.

Les compagnies d’IA le savent. C’est pour ça que les réponses de ChatGPT sont chaleureuses, empathiques, encourageantes. Ça rend l’outil plus agréable à utiliser. Mais c’est un choix de design, pas de la vraie émotion.

Le danger de croire que l’IA a des sentiments

Le vrai risque, c’est quand les gens développent un attachement émotionnel à l’IA. Ça arrive déjà. Des gens qui confient leurs problèmes à ChatGPT au lieu d’en parler à un ami. Des ados qui préfèrent jaser avec un chatbot qu’avec leurs parents.

C’est pas que l’IA donne de mauvais conseils (quoique, parfois oui). C’est que l’IA peut pas se soucier de toi. Elle peut pas remarquer que t’as l’air fatigué depuis deux semaines. Elle peut pas t’appeler pour prendre de tes nouvelles. La relation est à sens unique.

L’IA comme outil d’écriture, de réflexion, de productivité? Excellent. L’IA comme substitut de relations humaines? Dangereux.

La question mieux posée

Au lieu de « L’IA a-t-elle des émotions? », demande-toi plutôt : « Qu’est-ce que ça dit sur nous qu’on ait besoin de le croire? »

On projette nos émotions sur nos outils parce qu’on est des êtres sociaux. C’est normal. Mais être conscient de cette tendance, c’est important. Ça te permet d’utiliser l’IA pour ce qu’elle est — un outil puissant — sans lui donner un rôle qu’elle peut pas remplir.

Chez Laeka Research, on étudie exactement cette zone grise entre cognition humaine et artificielle. Et avec Sherpa, on t’aide à développer une relation saine avec l’IA. Utile, claire, sans illusions.